Tin giả và hình ảnh giả tràn lan: Đã đến lúc xây dựng bộ quy tắc đạo đức AI tại Việt Nam

Sự phát triển bùng nổ của trí tuệ nhân tạo (AI) đang mở ra nhiều cơ hội cho kinh tế và đời sống xã hội. Tuy nhiên, cùng với đó là nguy cơ tin giả, hình ảnh giả, video deepfake lan tràn trên mạng xã hội, gây nhiễu loạn thông tin và ảnh hưởng đến niềm tin của công chúng. Từ thực tế này, việc xây dựng một bộ quy tắc ứng xử đạo đức AI tại Việt Nam đang trở thành yêu cầu cấp thiết nhằm bảo đảm công nghệ được phát triển và sử dụng theo hướng minh bạch, có trách nhiệm và vì lợi ích xã hội.

Khi ranh giới thật - giả ngày càng mong manh

Trong vài năm gần đây, AI đã phát triển với tốc độ chóng mặt. Chỉ với vài thao tác đơn giản, người dùng có thể tạo ra những bức ảnh, đoạn video hoặc bài viết trông rất “thật”, dù hoàn toàn không tồn tại ngoài đời. Các công cụ tạo nội dung bằng AI ngày càng phổ biến, từ ứng dụng chỉnh sửa ảnh cho đến phần mềm tạo video và giọng nói giả.

Điều đáng lo ngại là công nghệ này đang bị lợi dụng để sản xuất tin giả, hình ảnh giả hoặc video “deepfake” nhằm câu lượt xem, gây hiểu nhầm, thậm chí phục vụ mục đích trục lợi hoặc bôi nhọ cá nhân, tổ chức. Không ít trường hợp hình ảnh các nhân vật nổi tiếng bị ghép vào bối cảnh nhạy cảm; video giả mạo phát biểu của lãnh đạo hoặc người nổi tiếng bị lan truyền trên mạng xã hội, khiến dư luận hoang mang, kích động dư luận, gây ảnh hưởng đến khối đại đoàn kết toàn dân tộc.

Các nội dung này thu hút lượng tương tác lớn, hầu hết các ý kiến bình luận đều không nhận ra đây là sản phẩm AI do có hình ảnh và nội dung “như thật”, rất khó để phân biệt.

Việt Nam nằm trong nhóm quốc gia có lượng người dùng mạng xã hội lớn, với hơn 70 triệu người sử dụng internet. Trong môi trường thông tin rộng mở như vậy, các nội dung giả mạo nếu không được kiểm soát kịp thời có thể lan truyền rất nhanh, gây tác động tiêu cực đến xã hội.

Phòng An ninh mạng và phòng, chống tội phạm sử dụng công nghệ cao, Công an Thành phố Hà Nội đã xử phạt một số trường hợp đăng tải video được tạo dựng từ AI có nội dung giả mạo, sai sự thật. Đơn cử, ngày 23/12/2025, Phòng An ninh mạng và phòng, chống tội phạm sử dụng công nghệ cao, Công an TP Hà Nội cho biết đã xử lý một cá nhân trú tại phường Tây Mỗ, là quản trị kênh YouTube “Tuổi Già Audio” (trước đây có tên “Kỳ Án Việt Audio”), do đăng tải nội dung sai sự thật được tạo dựng bằng AI. Theo cơ quan công an, cá nhân này thường xuyên đăng tải các video do AI tạo dựng, mô phỏng quá trình gây án và hình ảnh lực lượng công an phá án. Mục đích của việc đăng tải các video này nhằm thu hút người xem, gia tăng lượt tương tác để kiếm tiền quảng cáo từ YouTube. Ngày 6/11/2025, người này đã đăng tải một video có tiêu đề “Chấn động Chương Mỹ”. Nội dung vụ án trong video hoàn toàn không có thật, do đối tượng sử dụng AI để viết kịch bản và tạo dựng hình ảnh, gây hoang mang dư luận và khiến nhiều người xem hiểu lầm đây là sự việc có thật.

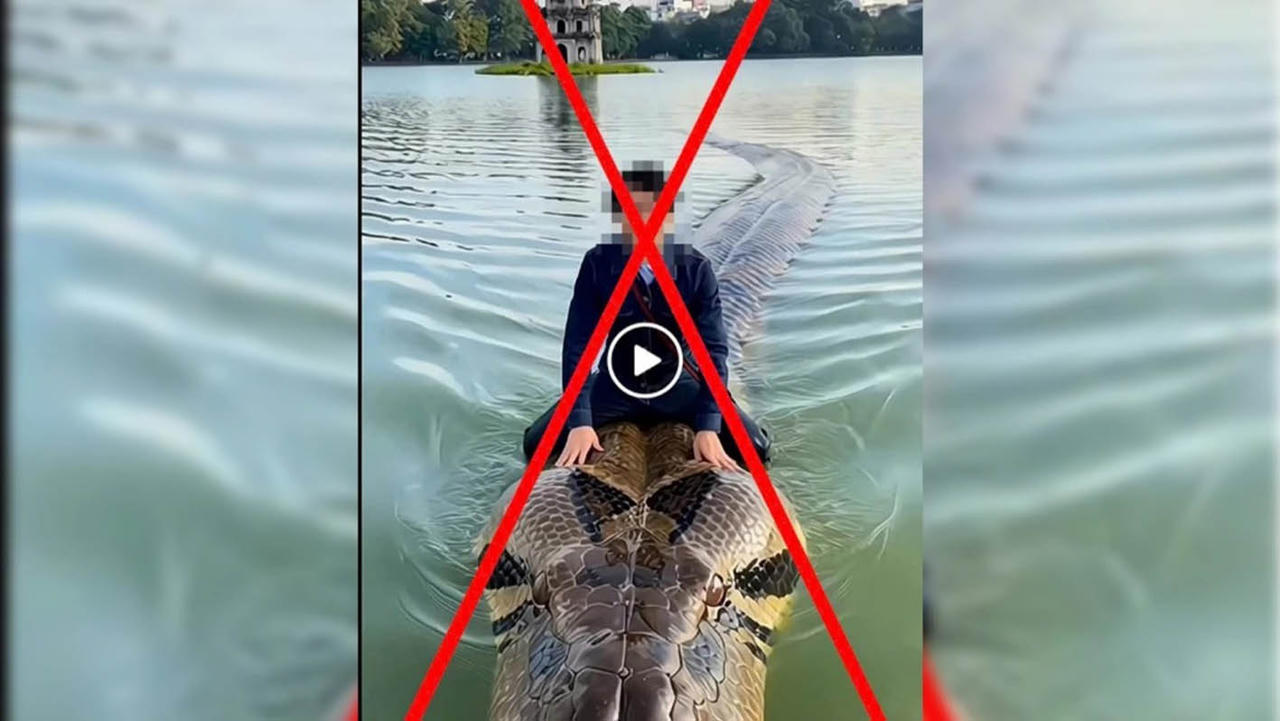

Ngày 25/12/2025, qua công tác nắm tình hình trên không gian mạng, lực lượng chức năng phát hiện một tài khoản mạng xã hội đăng tải video có tiêu đề “Truyền nhân Lạc Long Quân đây rùi”. Nội dung video thể hiện hình ảnh một người ngồi trên một con trăn khổng lồ bơi giữa hồ Hoàn Kiếm - hình ảnh hoàn toàn không có thật, được tạo dựng bằng công nghệ AI. Qua xác minh, Phòng An ninh mạng và phòng, chống tội phạm sử dụng công nghệ cao xác định chủ tài khoản là N.H.A. (sinh năm 1976, trú tại phường Thanh Xuân, TP Hà Nội). Làm việc với cơ quan Công an, N.H.A. thừa nhận đã sử dụng điện thoại để tạo video bằng AI, ghép hình ảnh cá nhân ngồi trên trăn khổng lồ tại hồ Hoàn Kiếm với mục đích “câu like”, “câu view” trên mạng xã hội…

Thực tế cho thấy, nhiều người dùng mạng chưa có kỹ năng nhận diện nội dung do AI tạo ra. Hình ảnh “như thật”, giọng nói giống thật, video được dựng tinh vi khiến việc phân biệt thật - giả trở nên khó khăn. Khi thông tin sai lệch được chia sẻ hàng nghìn lần, hậu quả không chỉ dừng ở sự hiểu nhầm, mà còn có thể làm tổn hại danh dự cá nhân, gây rối loạn dư luận, thậm chí ảnh hưởng đến an ninh thông tin.

Trước thực trạng trên, Phòng An ninh mạng và phòng, chống tội phạm sử dụng công nghệ cao Công an Thành phố Hà Nội khuyến cáo người dân nâng cao nhận thức trong việc nhận diện các sản phẩm từ AI có nội dung xuyên tạc, giả mạo để kịp thời ngăn chặn, tuyệt đối không chia sẻ, bình luận. Lực lượng chức năng nhấn mạnh, nghiêm cấm việc sử dụng công nghệ AI để tạo dựng, chỉnh sửa, phát tán thông tin sai sự thật; giả mạo danh tính nhằm vu cáo, lừa đảo, xâm phạm quyền và lợi ích hợp pháp của tổ chức, cá nhân, hoặc gây ảnh hưởng đến an ninh quốc gia, trật tự, an toàn xã hội.

Hướng tới một hệ sinh thái AI có trách nhiệm

Trước những rủi ro này, nhiều quốc gia và tổ chức quốc tế đã bắt đầu xây dựng các bộ nguyên tắc đạo đức cho AI. Năm 2021, Tổ chức Giáo dục, Khoa học và Văn hóa của Liên hợp quốc đã ban hành Khuyến nghị về đạo đức AI, trong đó nhấn mạnh các nguyên tắc như minh bạch, trách nhiệm giải trình, tôn trọng quyền con người và bảo vệ dữ liệu cá nhân. Liên minh châu Âu cũng đang triển khai Đạo luật AI nhằm kiểm soát các ứng dụng AI có nguy cơ cao, đặc biệt là những công nghệ có khả năng thao túng thông tin.

Nhiều tập đoàn công nghệ lớn trên thế giới cũng đưa ra các quy tắc nội bộ về sử dụng AI có trách nhiệm, yêu cầu gắn nhãn nội dung do AI tạo ra hoặc phát triển công cụ nhận diện deepfake. Những nỗ lực này cho thấy, cùng với việc thúc đẩy đổi mới sáng tạo, các quốc gia ngày càng coi trọng yếu tố đạo đức và trách nhiệm trong phát triển công nghệ.

Tại Việt Nam, AI đang được xác định là một trong những công nghệ trọng tâm của cuộc Cách mạng công nghiệp lần thứ tư. Chính phủ đã ban hành Chiến lược quốc gia về nghiên cứu, phát triển và ứng dụng AI đến năm 2030, đặt mục tiêu đưa Việt Nam trở thành trung tâm đổi mới sáng tạo về AI trong khu vực. Tuy nhiên, cùng với sự phát triển đó, những thách thức liên quan đến đạo đức và trách nhiệm trong sử dụng AI cũng ngày càng rõ rệt.

Một số chuyên gia công nghệ cho rằng, việc xây dựng bộ quy tắc ứng xử đạo đức AI tại Việt Nam không chỉ nhằm hạn chế các rủi ro như tin giả, deepfake hay vi phạm quyền riêng tư, mà còn góp phần tạo nền tảng phát triển AI bền vững và đáng tin cậy.

Bộ quy tắc này có thể bao gồm nhiều nguyên tắc quan trọng, như: Minh bạch (các nội dung do AI tạo ra cần được nhận diện hoặc gắn nhãn rõ ràng để người dùng biết đó không phải là sản phẩm của con người); Trách nhiệm giải trình (cá nhân, tổ chức phát triển hoặc sử dụng AI phải chịu trách nhiệm về các tác động của công nghệ đối với xã hội); Bảo vệ quyền riêng tư (việc sử dụng dữ liệu để huấn luyện AI cần tuân thủ các quy định về bảo mật và quyền cá nhân); Không gây hại (AI không được sử dụng để tạo nội dung gây thù hận, bôi nhọ hoặc lừa đảo)...

Việc xây dựng quy tắc đạo đức AI cũng cần có sự tham gia của nhiều bên, từ cơ quan quản lý nhà nước, doanh nghiệp công nghệ, giới nghiên cứu cho đến cộng đồng người dùng Internet. Bên cạnh các quy định và chuẩn mực đạo đức, một yếu tố quan trọng không kém là nâng cao nhận thức và kỹ năng của người dùng trước làn sóng nội dung do AI tạo ra.

AI là thành tựu công nghệ mang tính bước ngoặt, có thể tạo ra những thay đổi sâu sắc trong kinh tế, giáo dục, y tế và đời sống xã hội. Nhưng giống như bất kỳ công nghệ mạnh mẽ nào khác, AI cũng cần được định hướng bởi những giá trị đạo đức và trách nhiệm. Việc xây dựng bộ quy tắc ứng xử đạo đức AI tại Việt Nam vì thế không chỉ là giải pháp trước tình trạng tin giả hay hình ảnh giả tràn lan, mà còn là bước đi quan trọng để tạo dựng một hệ sinh thái công nghệ lành mạnh. Khi AI được phát triển và sử dụng trong khuôn khổ những chuẩn mực rõ ràng, công nghệ sẽ thực sự trở thành công cụ phục vụ con người, thúc đẩy sáng tạo, phát triển kinh tế và góp phần xây dựng một xã hội số minh bạch, đáng tin cậy.

Các chuyên gia truyền thông cho rằng, trong thời đại số, mỗi người dùng internet cần trở thành “người tiêu dùng thông tin thông minh”. Trước khi chia sẻ một hình ảnh hay video gây sốc, người dùng nên kiểm tra nguồn tin, đối chiếu với các kênh thông tin chính thống hoặc sử dụng các công cụ kiểm chứng. Các cơ quan báo chí, truyền thông cũng đóng vai trò quan trọng trong việc cung cấp thông tin chính xác, kịp thời và hướng dẫn công chúng nhận diện tin giả. Song song với đó, việc phát triển các công cụ công nghệ để phát hiện deepfake và nội dung giả mạo cũng cần được chú trọng. Đây được xem là “lá chắn công nghệ” giúp hạn chế những tác động tiêu cực của chính công nghệ.